- Os ensaios com UAV estão a tornar-se cada vez mais importantes. No entanto, os ensaios com drones envolvem frequentemente demonstrações dispendiosas no mundo real ou simulações 3D genéricas e limitadas.

- A principal vantagem desta plataforma é a sua capacidade de reproduzir ambientes do mundo real num ambiente virtual, tornando os testes com drones mais realistas, acessíveis e escaláveis.

- Dois algoritmos de aprendizagem profunda, YOLO v4 e Mask R-CNN, são utilizados para criar o ambiente de simulação 3D.

Índice

Necessidade atual de ambientes de simulação realistas

Com o rápido desenvolvimento da tecnologia e das aplicações dos drones nos últimos anos, a procura de veículos aéreos não tripulados (UAV) aumentou exponencialmente. Consequentemente, os fabricantes de drones têm confiado cada vez mais em ambientes simulados para testar os seus produtos, devido à sua relação custo-eficácia e segurança em comparação com os testes no mundo real. No entanto, os ambientes simulados genéricos e criados manualmente muitas vezes não conseguem apresentar os desafios encontrados em cenários do mundo real.

Então, como podemos resolver este problema para garantir que os cenários simulados reflectem com maior precisão as condições reais? Este foi o desafio enfrentado pelos investigadores Justin Nakama, Ricky Parada, João P. Matos-Carvalho, Fábio Azevedo, Dário Pedro e Luís Campos. Os seus esforços conduziram ao desenvolvimento de uma nova abordagem baseada em algoritmos de aprendizagem automática.

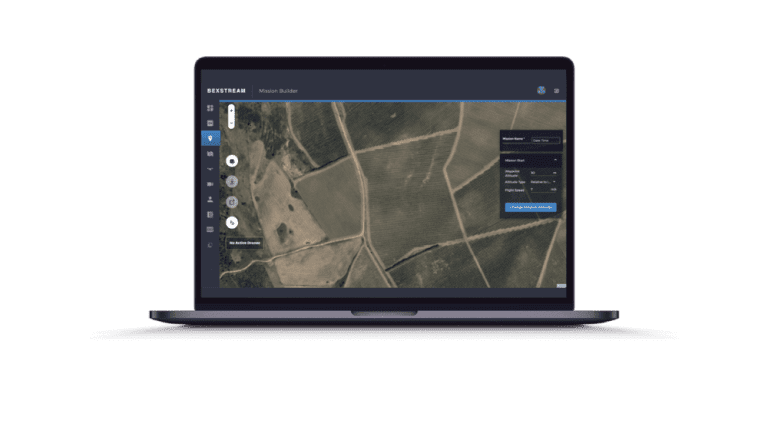

No seu artigo, Autonomous Environment Generator for UAV-Based Simulation, propõem um novo banco de ensaio em que a aprendizagem automática é utilizada para gerar, dimensionar e colocar modelos 3D de forma processual, resultando em simulações cada vez mais realistas. As imagens de satélite servem de base para estes ambientes, permitindo aos utilizadores testar UAVs numa representação mais detalhada de cenários do mundo real.

Embora ainda sejam necessárias algumas melhorias, o seu trabalho demonstra uma prova de conceito promissora para um gerador de ambientes que pode poupar tempo e recursos nas fases de planeamento, fornecendo cenários virtuais realistas para testes.

Continue a ler para saber mais sobre a tecnologia subjacente a este banco de ensaio inovador e as suas aplicações práticas.

Comparação: Como se comparam os simuladores existentes

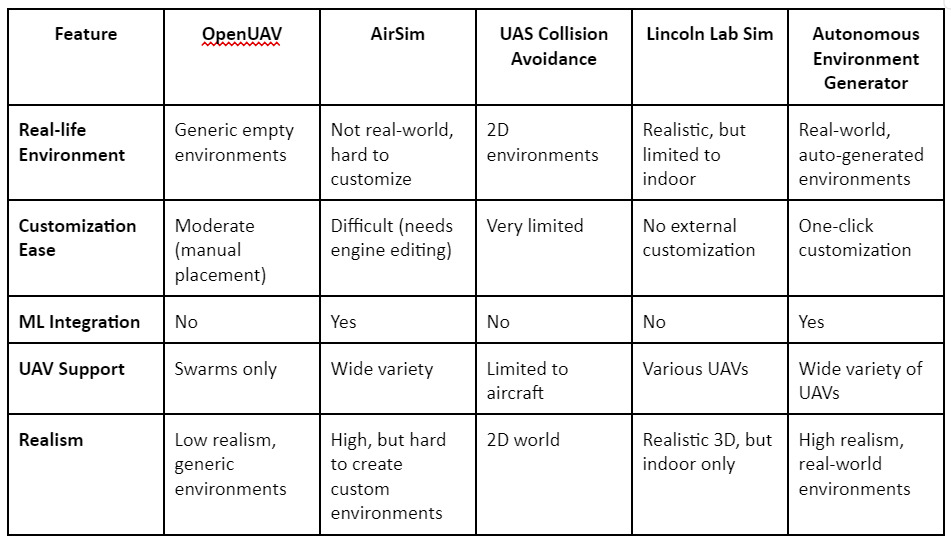

Já existem várias plataformas de teste de UAV, como o OpenUAV, o AirSim e o Lincoln Lab UAV Simulator. Embora estas plataformas ofereçam funcionalidades como testes de enxames de UAV ou renderização de alta qualidade, todas elas ficam aquém no que respeita à geração automática de ambientes realistas. Muitas exigem a colocação manual de modelos 3D e não oferecem a flexibilidade de simular localizações geográficas reais. A plataforma proposta neste documento preenche estas lacunas ao automatizar todo o processo utilizando imagens de satélite, gerando assim ambientes precisos a pedido.

Arquitetura do sistema e utilização de algoritmos de IA

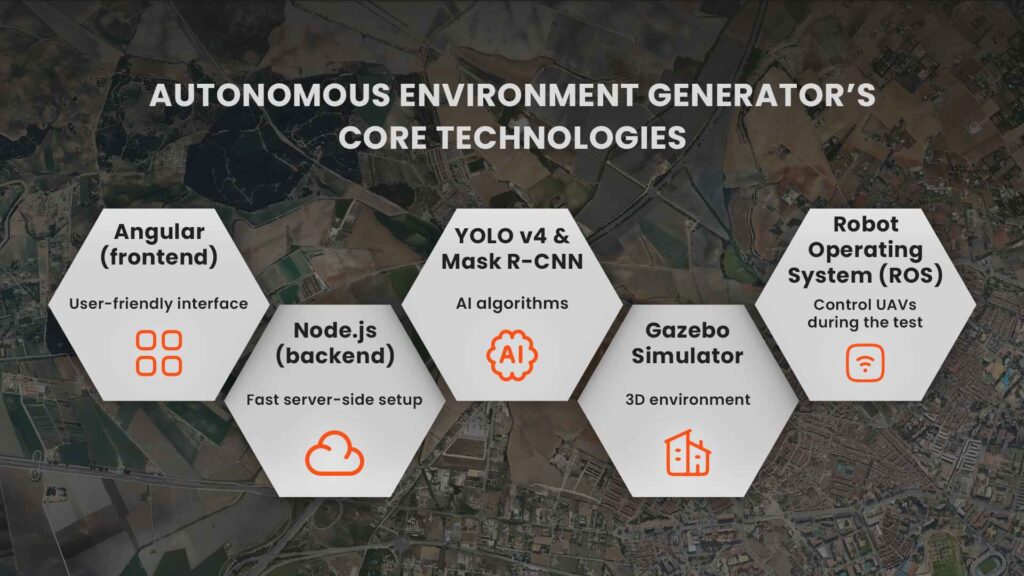

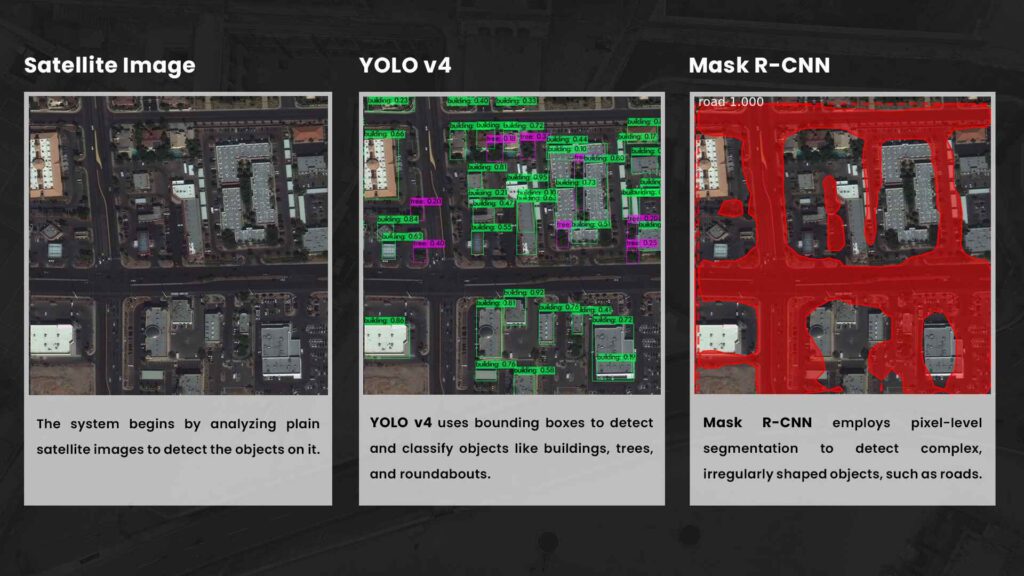

No centro do Gerador de Ambiente Autónomo está uma arquitetura que permite a representação do mundo real de qualquer área geográfica. Começa com imagens de satélite, que são processadas utilizando algoritmos de IA para detetar e replicar objectos como edifícios, árvores e estradas. Estes objectos detectados são depois colocados na simulação utilizando o simulador de robótica Gazebo 3D, assegurando que o ambiente espelha de perto o mundo real.

Tecnologias-chave por detrás do gerador de ambiente autónomo

A arquitetura do sistema é composta por:

A aprendizagem automática é a força motriz por detrás da capacidade desta plataforma para criar ambientes dinâmicos e reais. Dois algoritmos de inteligência artificial, YOLO v4 e Mask R-CNN, são utilizados para criar o ambiente de simulação 3D.

YOLO v4 é um modelo de deteção de objectos topo de gama que utiliza redes neurais convolucionais para identificar e localizar objectos nas imagens. Funciona dividindo as imagens numa grelha e prevendo a localização dos objectos utilizando caixas delimitadoras para cada região, permitindo uma deteção rápida e precisa. Especificamente, o YOLO v4 foi treinado no conjunto de dados DOTA, que consiste em imagens aéreas e de satélite, permitindo-lhe especializar-se na deteção de objectos como edifícios, árvores e rotundas a partir de uma vista aérea.

Máscara R-CNNpor outro lado, é utilizado para a deteção de estradas, o que requer uma segmentação ao nível do pixel. Gera máscaras que fornecem mais precisão para formas complexas que não se encaixam perfeitamente numa caixa delimitadora. Este modelo foi treinado utilizando o conjunto de dados Spacenet Road Network Detection Challenge.

Embora o YOLO v4 seja excelente para detetar certos objectos, a sua deteção de estradas é menos precisa, razão pela qual a Mask R-CNN é incorporada na arquitetura para uma segmentação mais detalhada.

Heifu: o UAV utilizado nas simulações

O gerador foi treinado em conjuntos de dados de imagens aéreas e consegue um equilíbrio entre velocidade e precisão. Quando as imagens de satélite são processadas e os objectos são detectados, os dados são enviados para o backend, onde são armazenados para utilização futura. Os modelos 3D de edifícios, árvores e outros objectos são então dimensionados e colocados no simulador Gazebo nas suas posições geográficas corretas. A simulação é controlada utilizando o Sistema Operativo de Robôs (ROS), que permite aos utilizadores controlar manual ou autonomamente os UAV durante o teste. Os UAVs interagem com estes modelos, permitindo aos testadores simular cenários de voo do mundo real, como a navegação num ambiente urbano.

Ambos os modelos foram testados numa variedade de imagens de satélite e tiveram um bom desempenho geral. No entanto, subsistem ainda alguns desafios, nomeadamente no que respeita à colocação de geometrias complexas de edifícios.

Embora o YOLO v4 seja excelente para detetar certos objectos, a sua deteção de estradas é menos precisa, razão pela qual a Mask R-CNN é incorporada na arquitetura para uma segmentação mais detalhada.

Embora o sistema atual careça de alguns pormenores gráficos avançados, a força da plataforma reside na sua escalabilidade e realismo. Elimina a necessidade de ambientes de teste físicos, tornando os testes de UAV mais baratos, mais rápidos e mais acessíveis.

O que vem a seguir? Melhorias no Gerador de Ambiente Autónomo

Embora o Gerador de Ambiente Autónomo seja já uma ferramenta poderosa, os autores descrevem algumas áreas para melhorias futuras:

Estas melhorias tornarão a plataforma ainda mais versátil e capaz de lidar com cenários de teste de UAV mais complexos no futuro.

Um Gerador de Ambiente Autónomo representa um futuro promissor para o teste de UAVs e é um sistema que revolucionará a forma como os fabricantes de drones testam e garantem o desempenho dos seus produtos.

Gerador de ambiente autónomo

Um sistema proposto que cria automaticamente ambientes 3D para testes de UAV utilizando inteligência artificial (IA) e imagens de satélite para reproduzir cenários do mundo real.

YOLO v4 (You Only Look Once, Versão 4)

Um algoritmo de deteção de objectos topo de gama que utiliza redes neuronais convolucionais (CNN) para identificar e localizar rapidamente objectos numa imagem, como edifícios e árvores.

Conjunto de dados DOTA

Um conjunto de dados de imagens aéreas utilizado para treinar o YOLO v4 na identificação de objectos em imagens de satélite, melhorando o seu desempenho em ambientes de teste de UAV.

Máscara R-CNN

Um modelo avançado de aprendizagem profunda que efectua a segmentação ao nível dos píxeis, identificando e delineando áreas específicas numa imagem, como estradas e formas complexas.

Conjunto de dados do desafio de deteção de redes rodoviárias da Spacenet

Um conjunto de dados utilizado para treinar o modelo Mask R-CNN para detetar estradas em imagens de satélite, ajudando a criar ambientes de simulação mais detalhados.

Redes Neuronais Convolucionais (CNNs)

Uma classe de algoritmos de aprendizagem profunda utilizados para analisar imagens visuais. O YOLO v4 e o Mask R-CNN baseiam-se ambos em CNNs para a deteção e segmentação de objectos.

Simulador Gazebo 3D

Uma ferramenta de simulação de robótica que apresenta ambientes físicos em 3D, permitindo o teste e o desenvolvimento de UAVs em cenários realistas.

ROS (Sistema Operativo de Robôs)

Uma plataforma de código aberto que fornece a estrutura para o controlo de robôs, incluindo UAVs, permitindo-lhes funcionar de forma autónoma ou ser controlados manualmente.

Resumo de 3 minutos

Não tem tempo para ler o artigo completo agora? Veja os pontos principais neste resumo de três minutos.

À medida que os drones e as suas aplicações ganham preponderância em sectores como a segurança, os transportes e a logística, os testes de UAV estão a tornar-se cada vez mais importantes. No entanto, o teste destes drones envolve frequentemente demonstrações dispendiosas no mundo real ou simulações 3D genéricas e limitadas que não reproduzem com exatidão os ambientes do mundo real. O documento, Autonomous Environment Generator for UAV-Based Simulation, apresenta uma solução inovadora: um sistema autónomo que gera ambientes de teste realistas para UAVs com base em imagens de satélite do mundo real.

Ao utilizar algoritmos de aprendizagem automática como o YOLO v4 e o Mask R-CNN, o sistema pode detetar objectos como edifícios, árvores e estradas em imagens de satélite e, em seguida, colocar modelos 3D desses objectos numa simulação. O simulador Gazebo é utilizado para renderizar estes ambientes, que podem depois ser navegados por drones controlados através do Sistema Operativo de Robôs (ROS).

A principal vantagem desta plataforma é a sua capacidade de reproduzir ambientes do mundo real num ambiente virtual, tornando os testes de UAV mais realistas, acessíveis e escaláveis. As plataformas actuais não têm precisão no mundo real ou requerem a colocação manual de objectos 3D, mas este sistema automatiza o processo, reduzindo significativamente o tempo e o custo envolvidos nos testes.

Apesar do seu sucesso, há áreas a melhorar, como a necessidade de modelos de objectos mais detalhados e tempos de carregamento mais rápidos. No futuro, a plataforma pretende incluir a capacidade de guardar e recarregar simulações, tornando-a ainda mais flexível para testes repetidos.

Respostas às suas perguntas

Uma rápida sessão de perguntas e respostas sobre as tecnologias de ponta por detrás dos testes de UAV, desde a geração de ambientes autónomos até à aprendizagem automática e simulações baseadas em satélites.